Hatespeech: Wie wir dem Hass im Netz begegnen können

Im Internet kann und darf jeder seine Meinung veröffentlichen. Das ist grundsätzlich eine tolle Errungenschaft. Doch spätestens im Zuge der Flüchtlingsdebatte wurde deutlich, dass bestimmte Personen und Gruppen im Netz sehr aggressiv kommunizieren und regelrecht Hass verbreiten. Dieser Beitrag skizziert die Dynamiken von „Hatespeech“ – und zeigt Strategien, wie Redaktionen dem Problem begegnen können.

Manche Menschen stören gern Gespräche, um sich und andere zu belustigen. Trollen ist so alt wie die Menschheit und das Internet ist ein Trollhaus. Doch „Hatespeech“ (engl. für Hassrede) stellt eine andere Dimension und größere Gefahr dar, denn dieses aggressive „verbale Hintergrundrauschen“ kann nicht nur die öffentliche Meinungsbildung beeinflussen, sondern mittelfristig auch Hemmschwellen derart senken, dass es Menschen zu realen Gewalttaten motiviert.

Meinungsfreiheit ist keine Narrenfreiheit: der rechtliche Rahmen

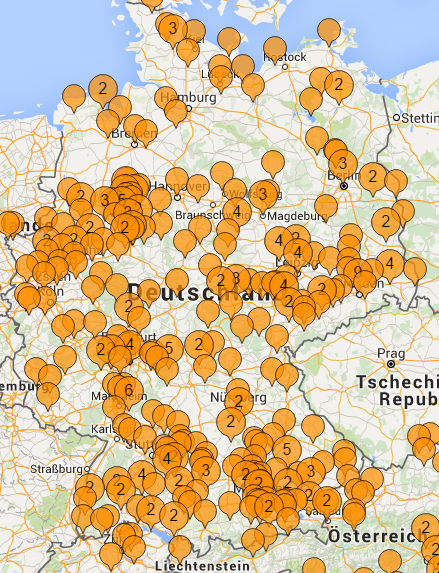

Hassreden richten sich in der Regel gegen bestimmte Personengruppen, meist religiöse oder ethnische. Seit dem Frühsommer 2015 sind im Zuge der europäischen Flüchtlingskrise vor allem Hasskommentare gegen Flüchtlinge zu beobachten (siehe Abb. 1).

Abb. 1: Die Seite hoaxmap.org hat Hunderte Falschmeldungen über Asylsuchende im deutschsprachigen Raum dokumentiert (Quelle: hoaxmap.org).

Leidenschaftliche Hasskommentatoren berufen sich in ihren Äußerungen in der Regel vehement auf den fünften Artikel des Grundgesetzes, ignorieren aber – wissend oder unwissend – dessen Einschränkungen:

„Jeder hat das Recht, seine Meinung in Wort, Schrift und Bild frei zu äußern … Diese Rechte finden ihre Schranken in den Vorschriften der allgemeinen Gesetze, den gesetzlichen Bestimmungen zum Schutze der Jugend und in dem Recht der persönlichen Ehre.“ (Grundgesetz Artikel 5)

Dabei haben nicht wenige Hassreden Inhalte, die die Grenzen der Meinungsfreiheit überschreiten. Einige Kommentare wären strafbar: das reicht von Beleidung, übler Nachrede und Verleumdung über die Verletzung der Menschenwürde bis hin zur Volksverhetzung.

„Wer … gegen eine nationale, rassische, religiöse oder durch ihre ethnische Herkunft bestimmte Gruppe … zum Hass aufstachelt … oder … die Menschenwürde anderer dadurch angreift, dass er … einen Einzelnen wegen seiner Zugehörigkeit zu einer vorbezeichneten Gruppe … beschimpft, böswillig verächtlich macht oder verleumdet, … wird mit Freiheitsstrafe von drei Monaten bis zu fünf Jahren bestraft.“ (Strafgesetzbuch § 130)

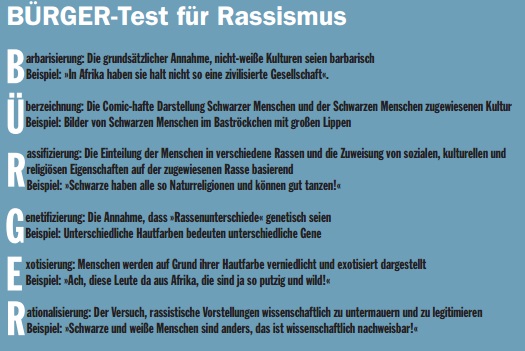

Die Amadeu-Antonio-Stiftung hat einen „Bürger-Test“ entwickelt und veröffentlicht, der mögliche Indikatoren für Rassismus aufzeigt und anhand von Beispielen deutlich macht (siehe Abb. 2).

Abb. 2: Der „Bürger-Test“ (Quelle: amadeu-antonio-stiftung.de)

Meinungsbildung und Störerhaftung: Wegsehen ist keine Lösung

Bei Trollen galt lange „Ignorance is bliss“ (Ignoranz macht selig), für Journalisten die Weisheit „don’t read the comments“ (lies die Kommentare nicht). Doch bei Hassreden sind ignorieren und wegschauen mittelfristig keine gute Strategie.

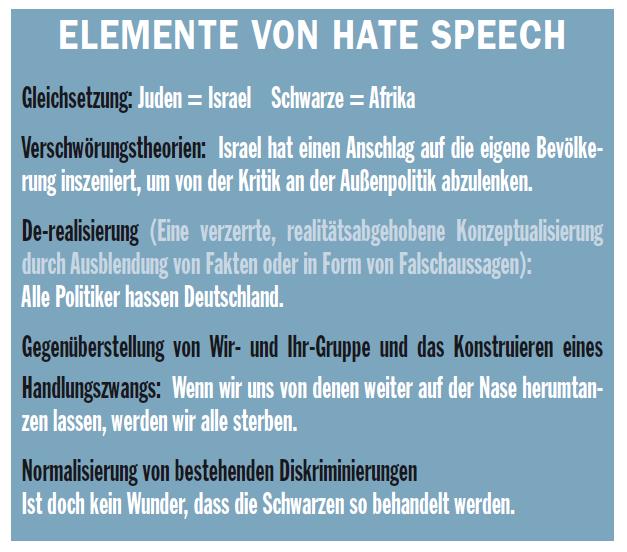

Viele Hassreden enthalten Halbwahrheiten, Fehlmeldungen und konstruierte Zusammenhänge; typische Elemente zeigt Abbildung 3. Im Netz prägen Meinungsäußerungen schnell die Meinungsbildung: die Prinzipien des Kopieren und Einfügens, des Teilens und Weiterreichens dienen nicht nur den Hassbotschaften als Katalysator, sondern liefern den Autoren und Lesern auch eine neue Art der Bestätigung und des Feedbacks, was sie mitunter zu weiteren Hassbotschaften motiviert; Wissenschaftler beschreiben dieses Phänomen als Echokammern der Wut und Angst. Und je häufiger Menschen in ihrem eigenen sozialen Umfeld Informationen wahrnehmen, desto höher ist laut wissenschaftlichen Studien die Chance, dass sie diese Informationen irgendwann für „die Wahrheit“ halten.

Abb. 3: An diesen typischen Elementen kann man Hatespeech erkennen (Quelle: amadeu-antonio-stiftung.de).

Eigentlich sollte es Aufgabe eines jeden ernst zu nehmenden Journalisten sein, an der öffentlichen Debatte teilzunehmen. Doch viele deutsche Zeitungsredaktionen kapitulierten im ersten Jahr der Flüchtlingsdebatte vor der Flut an Kommentaren und beschränkten ihre Kommentarbereiche.

Ein möglicher Grund hierfür ist auch das Prinzip der Störerhaftung bei Kenntnis. Medienunternehmen können für die Kommentare und Diskussionen auf ihren Webseiten und Social Media-Kanälen haftbar gemacht werden. Wer Imageschäden und Gerichtskosten vermeiden will, sollte sich demnach allein aus Selbstschutz mit den Methoden des Community-Managements befassen.

Hausregeln, Humor und Haltung: Was Moderatoren leisten können

Community-Manager steuern den Betrieb virtueller Gemeinschaften täglich unmittelbar, oft im direkten Kontakt mit den Nutzern. Zu ihren Aufgaben gehört es, bei Bedarf in Diskussionen einzugreifen, etwa wenn es Streit gibt oder Hasskommentare auftauchen.

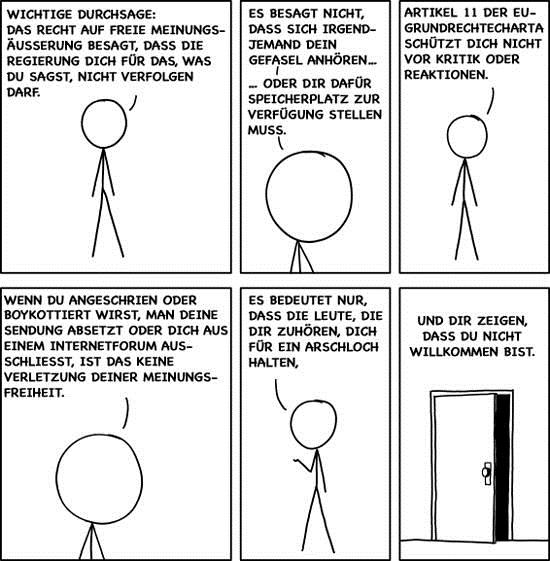

Geltendes Recht und klare Strukturen

Damit Community-Manager gegenüber allen Nutzern so nachvollziehbar wie möglich argumentieren und handeln können, sollten sie ein gewisses Regelwerk etablieren und immer wieder kommunizieren: Hierzu gehören Nutzungsbedingungen (was darf ich auf dieser Plattform), ein Verhaltenskodex (wie sollte ich mich verhalten) und Social-Media-Guidelines (was gilt für Mitarbeiter der Redaktion). Je klarer die Redaktion ihre eigene Haltung definiert, desto nachvollziehbarer kann sie gegenüber ihrer Community agieren (siehe Abb. 4).

Abb. 4: Eine Redaktion stellt klare Regeln auf (Quelle: https://xkcd.com/1357/ CC 2.5).

Allein auf Basis geltenden Rechts und der eigenen Hausregeln sollte der Community-Manager von Fall zu Fall entscheiden können, ob er einen Kommentar ausblendet oder löscht, ob er persönlich oder öffentlich Verwarnungen ausspricht, wann er Nutzer komplett blockiert oder gar ganze Diskussionen schließt. Der Community-Manager fungiert so als Schiedsrichter:

- Persönliche Verwarnung: Der Nutzer wird per E-Mail oder telefonisch freundlich informiert, dass er gegen die Regeln verstoßen hat und dies künftig bitte unterlassen möge.

- Gelbe Karte: Der Nutzer wird öffentlich ermahnt, dass er gegen die Hausregeln verstoßen hat und sein Account bei Wiederholung gesperrt wird.

- Rote Karte: Der Nutzer wird gesperrt.

Die „Süddeutsche Zeitung“ öffnet auf ihrer Webseite nur zu bestimmten Beiträgen die Kommentarfunktion und überprüft eingehende Kommentare, bevor sie öffentlich sichtbar werden (sogenannte Vor-Moderation). Das „kanalisiert“ Diskussionen zwar an konkret dafür vorgesehene Stellen, reduziert aber die Web-übliche Echtzeit-Dynamik maßgeblich. Einige Redaktionen experimentieren darüber hinaus auch mit einer speziellen Filter-Software gegen Hetzkommentare.

Humor kann helfen

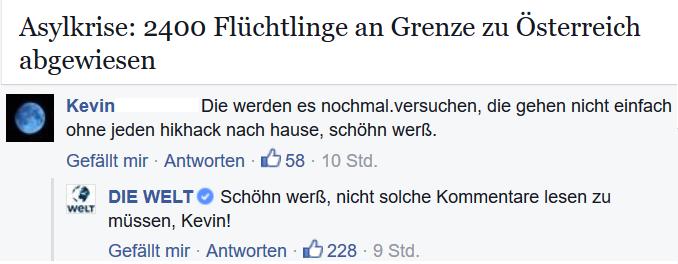

Unangenehmen Kommentaren, die strafrechtlich nicht relevant sind, kann man beispielsweise mit Humor begegnen. Das funktioniert allerdings nur, wenn eine Mehrheit der eigenen Nutzer diesen Humor unterstützt und der Störer deshalb schnell versteht, dass seine Botschaften an diesem Ort nicht willkommen sind (siehe Abb. 5).

Abb. 5: Die Redaktion der „Welt“ reagiert souverän auf einen „besorgten Bürger“. Die Community bedankt sich (Quelle: facebook.com/weltpraktikant).

Gegenrede, Gegenschlag und Internetwache

Gute Journalisten sind offen für Kritik und greifen in Diskussionen ein, indem sie Fakten und Belege einbringen. Das ist grundsätzlich ebenso löblich wie nachvollziehbar: Auf Hatespeech (Hassrede) folgt Counterspeech (Gegenrede). Bei Angriffen auf die Ehre besteht laut Bundesverfassungsgericht sogar ein Recht auf Gegenschlag.

Doch wer mit der schreienden Minderheit debattieren will, während die Mehrheit schweigend mitliest, benötigt nicht nur Mut, Ausdauer und Geduld, sondern sollte auch den sogenannten „Backfire-Effekt“ kennen: Danach muss eine Zunahme an Argumenten nicht unbedingt zum Konsens führen, sondern kann auch die jeweils persönlichen Standpunkte verstärken. „Wutbürger“ fühlen sich in ihrem Standpunkt mitunter sogar bestätigt, wenn „Gutmenschen“ und „Lügenpresse“ gegen sie anreden. Was also tun?

Die „Bild“-Zeitung prangerte in einer Titelgeschichte die schlimmsten Facebook-Hetzer an – namentlich und inklusive Profilbildern. Das brachte die Hatespeech-Problematik zwar auf die öffentliche Agenda, war aber persönlichkeitsrechtlich und moralisch umstritten. Ähnliches gilt für die Vorgehensweise, vermeintliche Nazis bei ihren Arbeitgebern zu melden oder gar ihre IP-Adressen zu hacken, um sie als Hassredner namentlich anzuprangern.

Wer sich nicht selbst zum Richter erheben will, vertraut auf das deutsche Rechtssystem und informiert die Behörden: Im Herbst 2015 beispielsweise hatte ein 26-Jähriger per Facebook gedroht, ein Flüchtlingsheim anzuzünden – 24 Stunden später wurde er bereits zu einer Haft- und Geldstrafe verurteilt. Die Redaktion des „Nordbayerischen Kuriers“ hingegen reagierte auf einen eindeutig fremdenfeindlichen Kommentar, indem sie ihn erst sicherte, dann löschte und Anzeige gegen den Hassredner erstattete. In den meisten Bundesländern bietet die Polizei mittlerweile sogar die Möglichkeit, online Anzeige zu erstatten.

Gleichsam betroffen, gemeinsam auf Lösungssuche

Communities und Interaktionen mit dem Publikum existieren schon eine ganze Weile, aber die Dynamik der jüngsten Hassreden – befeuert von Angst-und-Sorge-Parolen neuer gesellschaftlicher Gruppierungen – stellen Medienschaffende vor neue Herausforderungen und vor die Frage, welche Ressourcen man zur Betreuung der eigenen Onlineauftritte bereit stellen kann und will. Vielerorts entstehen derzeit neue Stellen und Abteilungen mit neuen Namen wie Social Media Management, Audience Development oder Listening Center.

Eine alte Web-Weisheit lautet zwar „Haters gonna hate“ (Hasser werden immer hassen), aber Hass, der nicht gebremst wird, kann eskalieren. Facebook, Twitter, YouTube und Microsoft haben deshalb gegenüber der Europäischen Union eine Absichtserklärung unterzeichnet, sich gegen illegale Hassreden einzusetzen. Deutsche Redaktionen täten gut daran, diesem Vorbild zu folgen.

Eine weitere Web-Weisheit lautet: „Eine gute Community reguliert sich selbst.“ Um den Umgang mit Hassreden als gesamtgesellschaftliche Aufgabe zu verstehen und mehr Bewusstsein für manipulative Falschmeldungen zu schaffen, hat der Europarat eine länderübergreifende Kampagne gegen Hasskommentare initiiert. Deren deutsche Webseite lautet schlicht und einprägsam: www.no-hate-speech.de

Literatur

- Stefan Krapitz: Troll culture (Selbstverlag 2012)

- Elisabeth Wehling: Politisches Framing: Wie eine Nation sich ihr Denken einredet – und daraus Politik macht (Halem Verlag 2016)

- Ingrid Brodnig: Hass im Netz – Was wir gegen Hetze, Mobbing und Lügen tun können (Brandstätter Verlag 2016)

- Johannes Baldauf u. a.: Geh sterben! Umgang mit Hate Speech und Kommentaren im Internet (Amadeu-Antonio-Stiftung 2015)

Links

- Katalog der Störenfriede: eine Typologie der Trolle

- Netiquette vor: Jedes solide Forum hat einen Verhaltenskodex für Nutzer.

- Alles rechtens: über die Gestaltung der Nutzungsbedingungen für Communities.

- Leitlinien helfen: Der Bundesverband Informationswirtschaft, Telekommunikation und neue Medien e. V. (BITKOM) zur Erstellung von Social Media Guidelines.

- Polizei online: eine Übersicht zu den Internetwachen der Bundesländer.

- Zum Nachblättern: Die Merkblätter zur Fachtagung „Hate Speech – Hass im Netz“ erscheinen im Juli 2016 unter ajs.nrw.de, eine Handreichung des Grimme-Instituts erscheint im Herbst 2016 unter bricks-project.eu.

Podcasts und Videos

- Der Bundesverband Community Management e.V. veröffentlicht regelmäßig Podcasts zu Themen der digitalen Moderation und Kommunikation.

- Auf der Re:publica, Deutschlands größter Digital-Konferenz, gab es im Jahr 2016 diverse Vorträge und Diskussionen zum Thema Hatespeech, die in dieser Playlist zusammen gefasst sind: Was tun gegen Hass, Hetze und Hatespeech?

Titelillustration: Esther Schaarhüls

Das Magazin Fachjournalist ist eine Publikation des Deutschen Fachjournalisten-Verbands (DFJV).

Der Autor Stanley Vitte studierte Sozialwissenschaften in Düsseldorf und europäische Politik in Brighton. Nach diversen Tätigkeiten bei Verlagen, Agenturen und im Rundfunk war er mehrere Jahre als Senior-Community-Manager des Bürgerportals Lokalkompass tätig. Heute ist er selbständiger Autor und Dozent.

Der Autor Stanley Vitte studierte Sozialwissenschaften in Düsseldorf und europäische Politik in Brighton. Nach diversen Tätigkeiten bei Verlagen, Agenturen und im Rundfunk war er mehrere Jahre als Senior-Community-Manager des Bürgerportals Lokalkompass tätig. Heute ist er selbständiger Autor und Dozent.

Kommentare

Trackbacks

Finden Sie heraus, was andere sagen...-

[…] – wie geht man damit um, was ist die Rechtslage? Stanley Vitte hat im Fachjournalist (@DFJV_News) einen großartigen Überblick zusammengestellt mit vielen praktischen […]

Herzlichen Dank für die Empfehlung!